Introducing Apple Vision Pro

•

Apple의 CEO인 팀 쿡(Tim Cook)은 “오늘은 컴퓨팅 방식에 있어 새로운 시대의 시작을 알리는 날이다” 라며, “Mac이 개인 컴퓨터를 그리고 iPhone이 모바일 컴퓨팅의 시대를 열었던 것처럼 Apple Vision Pro는 우리에게 공간 컴퓨팅을 선보이게 되었다"라고 소개하였습니다.

•

애플은 HMD를 처음부터 VR디바이스가 아닌 착용가능한 독립적인 컴퓨터로 설계하고 출발하였습니다. 그래서 운영체제도 처음부터 집과 작업공간에서 사용가능하도록 만들었습니다.

◦

Vision Pro 공간 컴퓨팅을 위해 5000개 이상의 특허 출원

◦

단순한 신제품이 아닌 새로운 플랫폼의 탄생이라고 발표

▪

하나의 독립적인 증강현실 기반의 컴퓨터

Specs

Display : Micro OLED on Silicon (OLEDoS)

•

기존 디스플레이보다 훨씬 작은 패널 크기에 더 많은 픽셀을 넣어 한쪽 눈당 4K + 90/96Hz Refresh Rate

•

주의할 점은 Micro LED가 아닌 완전히 다른 기술인 Micro OLED (Microdisplay + OLEDoS)

◦

일반적인 OLED는 유리기판 위에 증착시켜 만드는 방식인데 반해

◦

SONY가 이번에 만든 이 OLEDoS (OLED on Silicon) 방식은 실리콘 웨이퍼 위에 반도체공정으로 만드는 방식(WOLED+CF, White OLED + Color Filter) -> 백플레인과 구동회로부에 반도체 공정에서 만들어지는 초미세 회로 구조까지 재현할 수 있게 됨

▪

SONY가 2011년 이 WOLED+CF 기술을 발표

◦

LGDisplay는 Vision Pro의 외부 곡면 디스플레이인 eyeSight 곡면 디스플레이는 LG 디스플레이 사용

▪

WOLED+CF 방식 개발중이고 실리콘 웨이퍼만 반도체업체와 협력하여 차세대 애플의 제품에 넣으려고 노력중임

▪

LG 디스플레이는 2020년 0.42 inch / 3,500 PPI / OLEDoS 디스플레이를 공개한 적 있음

◦

삼성도 WOLED+CF 방식을 2024년 양산 목표로 3,000 PPI의 디스플레이를 개발하고 있고, WOLED+CF보다 더 정교한 방식인 RGB-based Micro OLED 방식이 있는데, 삼성디스플레이가 2억 1800만 달러(2900억원)에 미국 이메진(eMagin)을 인수하면서 진행되고 있습니다.

•

폰 1픽셀의 크기에 64픽셀을 넣어 양안 총픽셀 수 23M 픽셀 (2300백만)이 들어감, 4000 PPI

◦

Meta Quest Pro는 3.46M per-eye, 양안 6.91M 픽셀 (700백만 정도), 1200 PPI

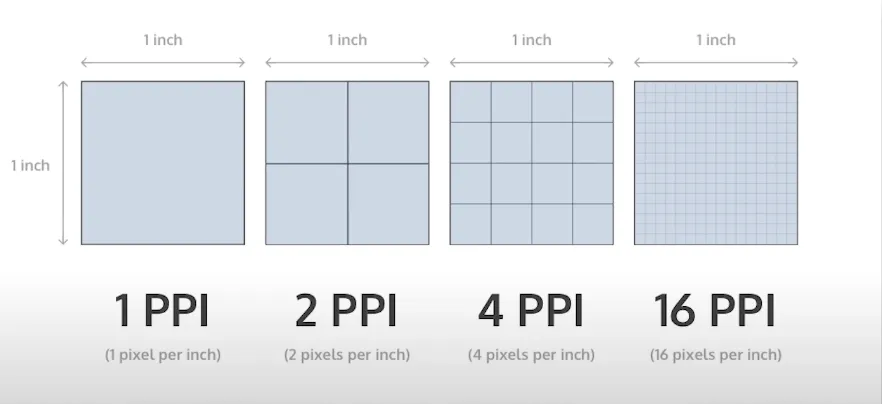

▪

PPI란 1인치 안에 들어가는 픽셀수를 말합니다.

•

대형TV의 경우 멀리서 보기때문에 100 PPI 정도, 스마트폰은 400~600 PPI 정도(태블릿은 스마트폰보다 좀 더 낮음), HMD는 3000~6000 PPI

Camera, Sensor

•

아이트래킹, 페이스트래킹 지원

•

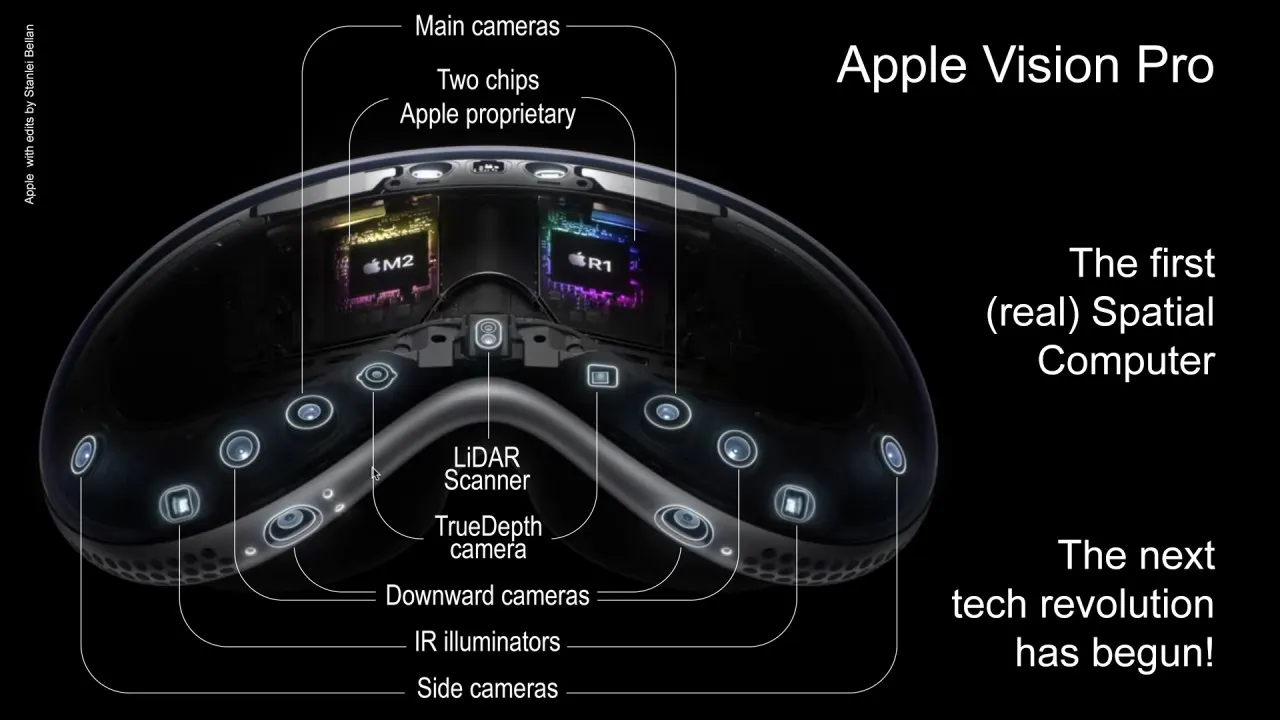

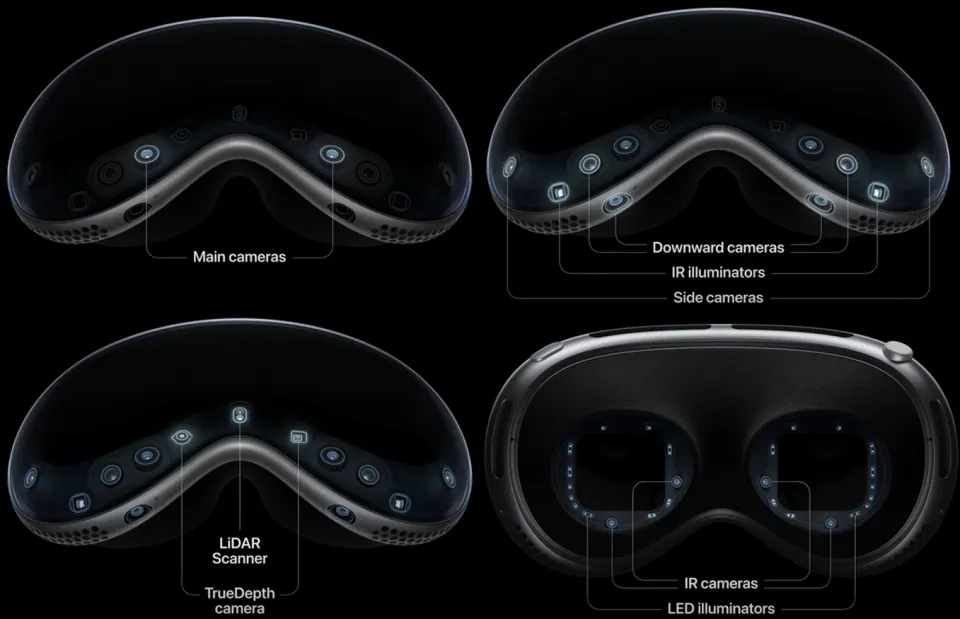

핸드제스처를 모니터링하기 위한 카메라 12개와 센서 5개, 마이크 6개

◦

전면 : 양안 메인 카메라, Downward camera, IR Illuminators, Side cameras, LiDAR Scanner, TrueDepth camera

◦

안쪽 : 고성능 아이트래킹 시스템 탑재, IR cameras, LED illuminators

Processor

•

맥북에 사용되는 M2과 새로운 R1 듀얼 칩 프로세서

◦

R1칩은 위 카메라와 센서, 마이크 6개의 정보를 실시간으로 처리하고 12 밀리초(0.012초) 안에 새로운 이미지를 화면에 스트리밍합니다.

Body

•

특수 알루미늄 합금 프레임과 유리가 매끄럽게 연결된 모습

•

헤드 밴드는 천 재질로 제품의 스트랩에 연결해서 사용

Battery

•

외장배터리 2시간

Features

Display

•

4K 해상도로 동영상 렌더링하는 기능 지원

•

ZEISS와 협업해 안경사용자들을 위한 커스텀 렌즈 렌즈부에 마그네틱으로 부착

3D 인터페이스

•

Light / Dark 모드가 없고 Glass 형태로 앱이 띄워지며 3D인터페이스들은 자연광에 반응하고 그림자를 드리워 사용자가 공간의 크기감과 거리감을 느낄 수 있도록 도와줍니다.

•

Vision Pro는 공간을 탐험하듯한 경험을 위해 사람의 눈과 손 그리고 음성으로 제어 가능한 완전히 새로운 입력 체계를 도입하였습니다.

Control

•

컨트롤러는 없고 눈, 제스처, 목소리로 인식

•

검색창을 바라본 후 목소리로 검색어 입력하는 모습

•

컨트롤에 Siri를 지원

Eyesight

•

외부 곡면 OLED 패널과 렌티큘러(Lenticular) 렌즈를 통해 Pass-through로 디스플레이에 표시해주는 기능

Optic ID

•

홍채인식으로 유저의 보안을 강화하거나 인식할 수 있는 새로운 인증수단이 생겼습니다.

Digital Crown

•

디지털 크라운을 돌려 특정 ‘환경’에서 얼마나 현실에 가까운지 혹은 몰입한 상태인지를 결정할 수 있습니다. (현실 <-> 몰입 정도를 조절)

Spatial Audio

•

오디오 레이트레이싱 : 물건의 질감의 특징을 카메라로 분석해 주변에서 자연스럽게 사운드가 들려오는 것처럼 체감할 수 있게 해줍니다.

Digital Persona

•

Main Camera, Depth Camera, LiDAR Sensor 등을 이용해 얼굴을 스캔하여 반실사 느낌의 아바타를 만들어주어 EyeSight 외부 디스플레이나 페이스타임 등에 사용됩니다.

Developer and Tech YouTubers' Demo Review

초대된 사람들은 30m - 1hr 정도 체험

Good

•

창 자체가 선명하게 렌더링되고 빠르게 움직임

•

하드웨어 훌륭하다고 생각

•

헤드밴드 편안하고 빠르게 조절가능

•

핸드 제스처가 무릎 위에서도 잘 인식됨

•

전면 3D카메라 촬영 결과가 매우 좋았음

•

환경몰입 기능이 매우 Smooth하고 신비로운 경험

•

아바타2 3D 일부 부분을 체험했었는데 화질과 느낌은 영화관보다 좋았음

•

환경메뉴 선택해서 몰입상태 바꾸는 기능이 정말 매력적이고 화질이 매우 좋아 몰입할 수 있었음

Bad

•

타겟이 AR인 점에서 기존 VR기기의 방향과 차이점이 있으나 기술적으로는 기존 HMD 존재하거나 소개되었던 기술 범위 안에 있었음.

•

시야각은 기존 HMD의 수준이어서 시야는 해비유저에게는 아직 답답함

•

생각보다 가볍지 않고 묵직하다

•

EyeSight 모드에서 약간의 모션블러 생기긴 함

•

Passthrough는 소개된 것과는 조금 다르게 아이폰으로 찍은 정도의 수준이었음

•

공간 컴퓨팅의 시작이라는 애플의 주장에 다 만족한다고 얘기하기는 어려움

•

기존 XR기기의 해상도처럼 격자느낌이 나는 부분 없이 정말 선명했으나 구석에 있는 대상을 바라볼 땐 오차가 생기는 경우도 있었음

•

디스플레이의 시야 가장자리는 약간 흐릿한 느낌이 있음

•

공간음향 스피커는 아직 새롭거나 차별화된 느낌은 없었음

•

일부 부분만 3D가 아니라 전체가 3D인 Immersive Movie를 감상할 수 있었는데, 기존보다는 훨씬 좋지만 현실체험 수준까지는 아님

•

간혹 극미세한 컬러 모래알 같은게 느껴질 때는 있음

Semi-Conclusion

•

해비유저의 기대만큼은 아니었던 점도 있었다. 하지만 아직 완성되지 않았음에도 지금까지의 완성도와 전체적인 면에서도 충분히 정말 잘 만들어졌다로 소결론을 종합해볼 수 있을 것 같습니다.

Concept Accessary

Apple Vision Joystick Pro Max

•

현재까지의 기존 XR디바이스의 UX을 바탕으로 아직 쉽고 빠르고 정확한 입력을 위해 컨트롤러가 필요하다고 생각하는 사람들이 대다수입니다. 그래서 아래와 같은 컨셉디자인과 필요성에 대해서도 커뮤니티에서 논의되고 있는 것을 볼 수 있습니다.

Dark Knight Apple Vision Pro Case

•

기본적으로 사람들과의 격리되지 않도록 만들어졌기때문에 EyeSight 만으로는 충분하지 않고

Vision OS Demo

NovaUI

•

현재 Quest Pro에서만 작동되는 Vision Pro UI를 설치하여 체험해볼 수 있음

Insight

•

공간컴퓨팅에 걸맞게 기존의 방법보다는 애플에서 3D공간에서의 UX가 많이 향상된 점들이 있습니다. XR UX는 아직까지 더 나은 경험을 위해 빠르게 발전하고 있습니다.

•

지금 사용되기 시작한 WebGPU는 아직은 Safari 브라우저에는 직접 제공되지 않지만 곧 지원될 것으로 보이고, Chrome 어플을 이용하여 WebGPU 를 경험할 수 있습니다.

•

WebGPU로 직접적으로 Swift로 개발하지 않아도 VisionOS에 광범위한 컨텐츠들을 브라우저에서 제공할 수 있을 것으로 보입니다.

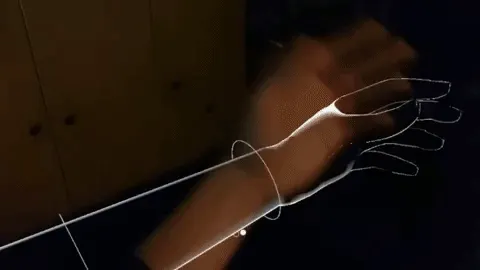

•

핸드트래킹 이외에도 팔목, 팔둑까지 트래킹하여 작동되는 인터페이스를 개발하는 사람들도 생기고 있습니다.

•

VisionOS는 MacOS와 iOS개발자가 기존의 방법으로 개발할 수 있게 애플이 많이 노력한 만큼 초기시장에서 시도해볼 서비스들이 분명 있을 것으로 예상됩니다.